L’énergie de l’IA face au coût biologique de l’intelligence

La question de la consommation énergétique des intelligences artificielles est devenue un sujet brûlant dans les débats technologiques et environnementaux actuels. Sam Altman, le directeur général d’OpenAI, a tenu à apporter une perspective nouvelle sur cette problématique lors de sa récente intervention publique. Selon lui, les critiques qui visent l’appétit vorace des modèles numériques oublient souvent de le mettre en perspective avec d’autres formes de développement.

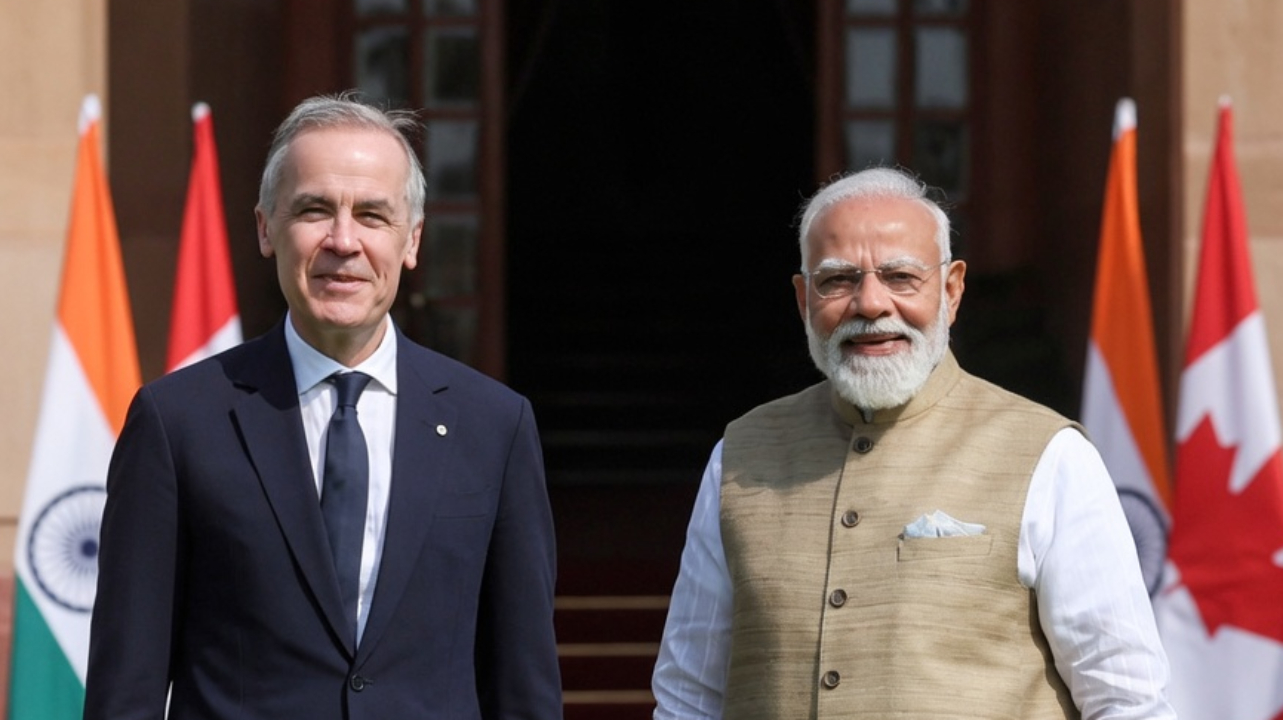

Présent en Inde cette semaine pour participer au sommet AI Impact, le dirigeant de l’entreprise créatrice de ChatGPT a établi un parallèle audacieux entre l’entraînement des machines et l’éducation des êtres humains. Il invite les observateurs à considérer l’investissement énergétique global que les sociétés consacrent au développement de l’intelligence biologique, et pas seulement artificielle.

Cette prise de parole intervient alors que le monde s’interroge sur l’empreinte carbone des data centers nécessaires au fonctionnement des grands modèles de langage. Pour Sam Altman, il est essentiel d’élargir le contexte de cette discussion pour comprendre les coûts réels liés à l’acquisition de connaissances, qu’elles soient synthétiques ou organiques.

Vingt ans de nourriture : le prix de l’intelligence humaine

Au cœur de son argumentation, Sam Altman a proposé une comparaison chiffrée et imagée pour relativiser la consommation des serveurs informatiques. Il a souligné que le processus pour rendre un être humain compétent et cultivé requiert une quantité de ressources souvent sous-estimée par le grand public.

Lors d’un entretien accordé au journal The Indian Express, le PDG d’OpenAI a déclaré : « Les gens parlent de la quantité d’énergie nécessaire pour entraîner un modèle d’IA. Mais il faut aussi beaucoup d’énergie pour former un humain. Il faut environ 20 ans de vie — et toute la nourriture que vous consommez pendant cette période — avant de devenir intelligent. »

Cette déclaration vise à replacer le débat énergétique dans un contexte plus large, suggérant que toute forme d’intelligence avancée, qu’elle soit faite de silicium ou de chair, exige un tribut énergétique conséquent pour émerger. Altman insiste sur le fait que la formation, quelle que soit sa nature, n’est jamais gratuite en termes de ressources.

L’Inde, nouvelle locomotive de la révolution IA

Au-delà des considérations énergétiques, le passage de Sam Altman en Inde a été l’occasion de souligner le rôle prépondérant de ce pays dans l’échiquier technologique mondial. Le dirigeant a affirmé que l’Inde ne se contente pas de suivre le mouvement, mais qu’elle se positionne désormais comme un acteur de premier plan dans l’adoption de l’intelligence artificielle.

Selon lui, le pays est en passe de devenir l’un des plus grands marchés pour cette technologie. Il a précisé que la nation indienne ne fait pas que participer à la révolution de l’intelligence artificielle, mais qu’elle aide activement à la diriger, témoignant ainsi d’une dynamique locale particulièrement forte et influente.

Cette reconnaissance de l’importance stratégique de l’Inde démontre le déplacement progressif du centre de gravité de l’innovation technologique, qui s’étend bien au-delà de la Silicon Valley pour toucher les grandes puissances émergentes.

Le danger du monopole et la nécessité de démocratiser

Abordant les questions de sécurité et de gouvernance, Sam Altman a exprimé ses craintes quant à la centralisation excessive du pouvoir technologique. Se basant sur son analyse de l’histoire, il a averti que laisser le contrôle de l’IA entre les mains d’une seule entreprise ou d’un seul pays serait une chose « désastreuse », même si cela était fait au nom de la sécurité.

Lors d’un briefing organisé en marge du sommet, il a explicité la position de son entreprise face à ce risque : « Je partage l’inquiétude concernant la concentration de l’IA. Notre position est que la seule voie à suivre est de démocratiser fortement l’IA et de mettre ces outils entre les mains des gens, même si cela comporte certains inconvénients, même si cela signifie que la société doit lutter avec de grands défis. »

Pour le dirigeant, le monopole est donc une menace bien plus grande que les désordres potentiels liés à une large diffusion. Il prône une approche où la technologie est rendue accessible au plus grand nombre, afin d’éviter l’hégémonie d’une entité unique sur ces outils puissants.

Accepter l’imparfait pour responsabiliser la société

Pour concrétiser cette vision, OpenAI a mis en place une stratégie que Sam Altman qualifie de « déploiement itératif ». Cette méthode consiste à permettre au public de se familiariser avec les systèmes d’intelligence artificielle et de les utiliser, même lorsque ces derniers sont encore imparfaits ou en cours d’évolution.

Le PDG a détaillé cette philosophie avec précision : « Et cela ne signifie pas que nous ne sommes pas responsables de la manière dont nous le faisons, cela ne signifie pas que nous ne commençons pas de manière conservatrice, mais cela signifie que nous donnons aux gens le pouvoir de faire des choses avec la technologie que nous-mêmes pourrions ne pas aimer. Cela signifie que nous essayons d’encourager la construction d’un écosystème robuste à travers le monde. »

En conclusion de son intervention, il a résumé l’esprit de cette démarche d’ouverture : « Cela signifie que nous acceptons le compromis de donner du pouvoir aux gens et d’accepter que la société doive se débattre avec une nouvelle chose, plutôt que d’essayer de garder tout le pouvoir pour nous et de dire que nous pouvons garantir tel ou tel résultat. »

Selon la source : news18.com