La plus grande collection mondiale de problèmes de mathématiques de niveau olympiade est désormais accessible à tous

Auteur: Mathieu Gagnon

Un trésor mathématique enfin révélé au grand public

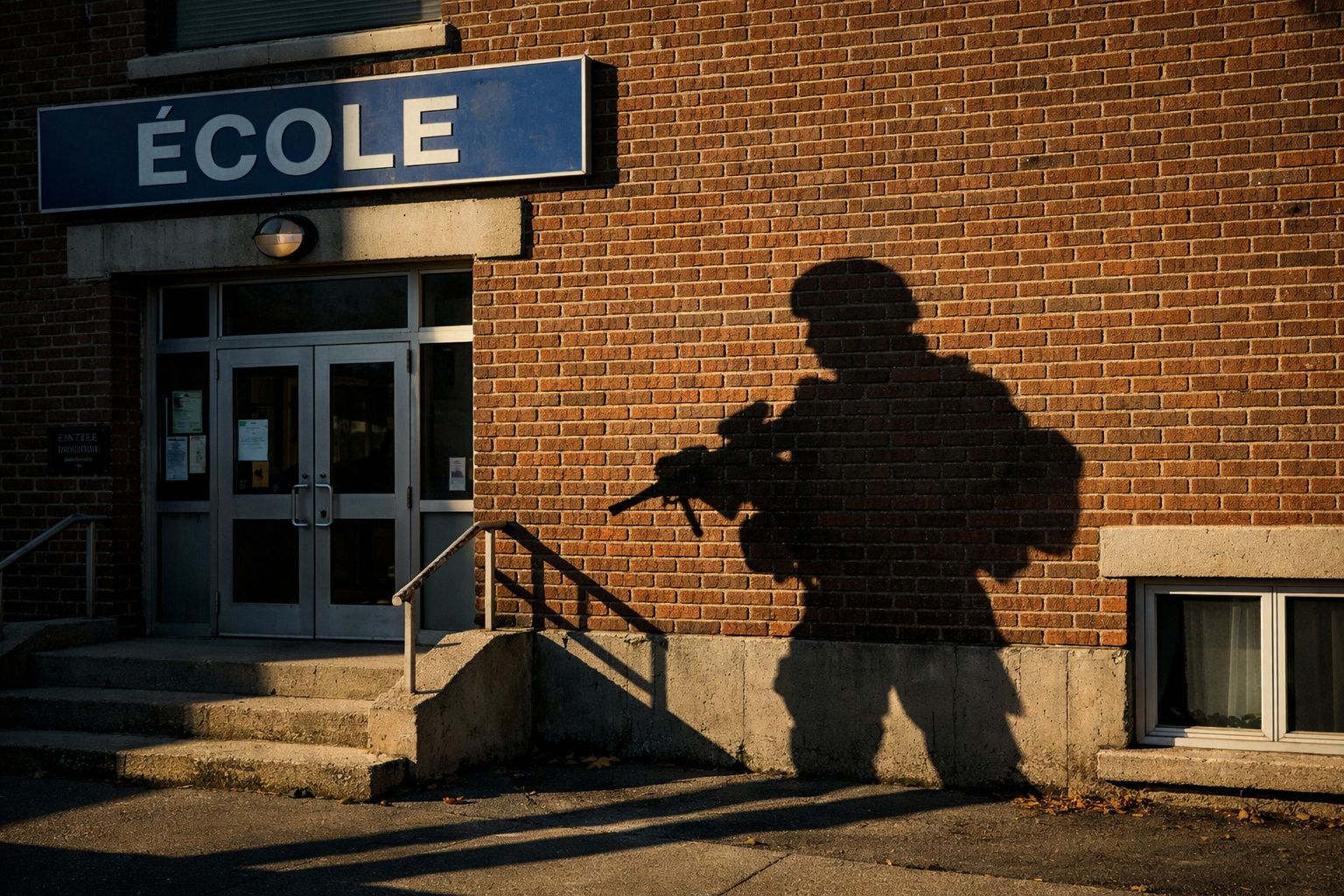

Chaque année, lors des Olympiades Internationales de Mathématiques (OIM), les pays participants arrivent avec un précieux bagage : des livrets remplis de leurs problèmes les plus originaux et complexes. Ces documents circulent entre les délégations avant de sombrer dans l’oubli. Jusqu’à présent, personne n’avait entrepris de les collecter, de les organiser et de les rendre accessibles, que ce soit pour les chercheurs en intelligence artificielle ou pour les étudiants du monde entier qui se préparent seuls à ces compétitions exigeantes.

Cette lacune est désormais comblée. Des chercheurs du Laboratoire d’Informatique et d’Intelligence Artificielle du Massachusetts Institute of Technology (CSAIL), de l’Université des sciences et technologies du roi Abdallah (KAUST) et de HUMAIN ont uni leurs forces pour accomplir cette mission. Le fruit de leur travail : une base de données révolutionnaire qui promet de changer la donne pour l’IA et l’éducation mathématique.

MathNet : une base de données d’une ampleur inédite

Le projet, baptisé MathNet, représente la plus vaste collection de problèmes mathématiques de haute qualité jamais créée. Et elle est ouverte à tous. Avec plus de 30 000 problèmes et solutions rédigés par des experts, provenant de 47 pays, traduits en 17 langues et issus de 143 compétitions différentes, MathNet est cinq fois plus grande que la plus importante base de données du même type existante. Ces travaux seront présentés ce mois-ci lors de la Conférence Internationale sur les Représentations de l’Apprentissage (ICLR 2026) au Brésil.

Ce qui distingue MathNet n’est pas seulement sa taille, mais aussi sa diversité. Les précédentes collections se concentraient presque exclusivement sur des compétitions américaines et chinoises. MathNet, au contraire, couvre des dizaines de pays sur six continents et quatre décennies de compétitions. Elle inclut des problèmes et des solutions sous forme de texte et d’images, capturant ainsi toute la richesse des perspectives mathématiques et des traditions de résolution de problèmes à travers le monde.

Shaden Alshammari, doctorante au MIT et auteure principale de l’étude, explique la genèse du projet : « Chaque pays apporte un livret contenant ses problèmes les plus nouveaux et les plus créatifs. Ils partagent les livrets entre eux, mais personne n’avait fait l’effort de les collecter, de les nettoyer et de les mettre en ligne. »

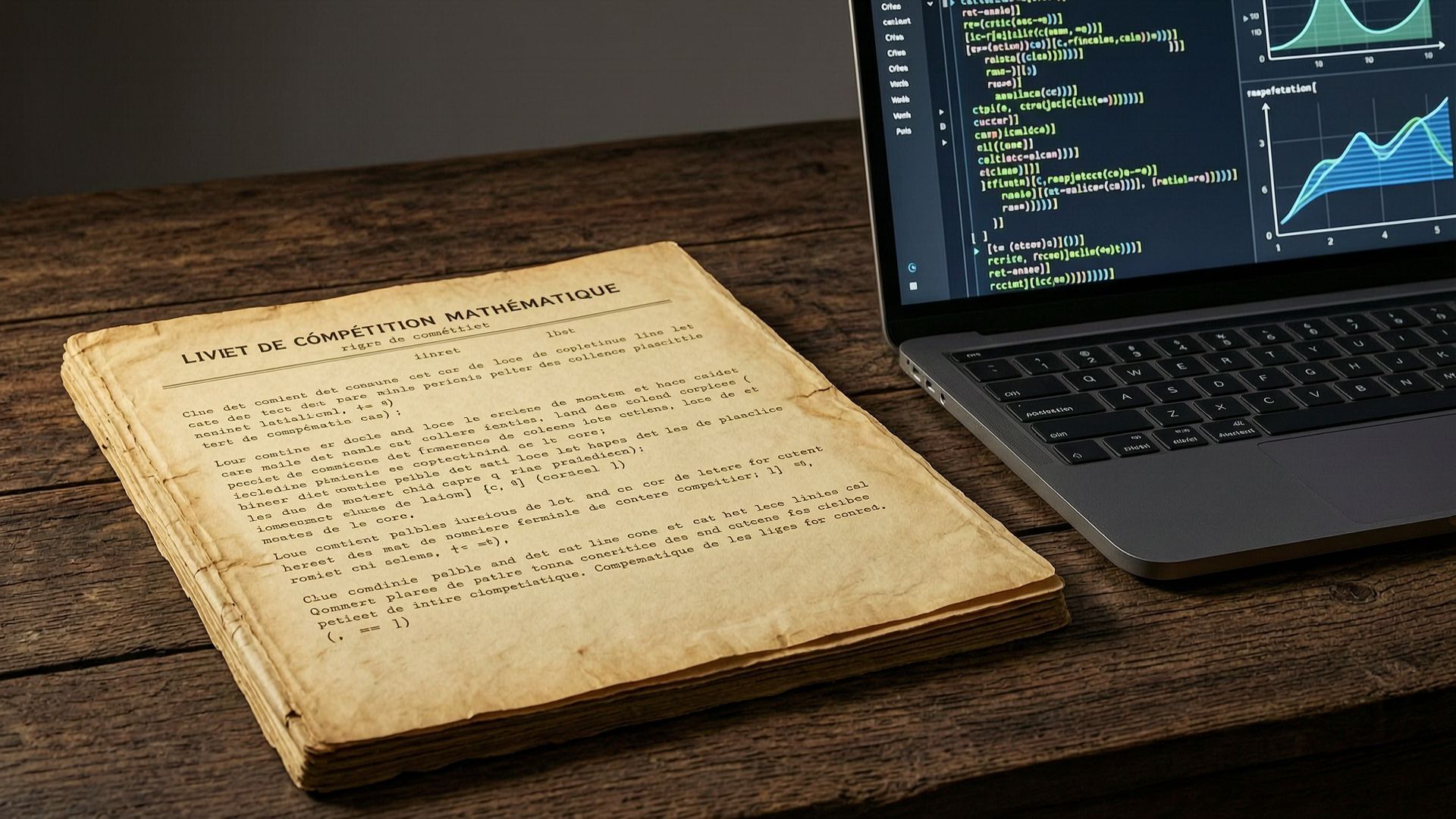

La quête patiente des sources originales

La construction de MathNet a été un travail de longue haleine. L’équipe a dû retrouver 1 595 volumes de PDF, totalisant plus de 25 000 pages, mêlant documents numériques récents et scans de plusieurs décennies dans plus d’une douzaine de langues. Une part considérable de ces archives provient d’une source inattendue : Navid Safaei, une figure de longue date de la communauté des OIM et co-auteur de l’étude, qui collectait et numérisait manuellement ces livrets depuis 2006. Ses archives personnelles ont constitué l’épine dorsale de la base de données.

La provenance des problèmes est aussi cruciale que leur volume. Alors que la plupart des bases de données existantes extraient leurs problèmes de forums communautaires comme Art of Problem Solving (AoPS), MathNet puise exclusivement dans les livrets de compétition nationaux officiels. Les solutions qui y figurent sont rédigées par des experts, relues par des pairs et s’étendent souvent sur plusieurs pages, les auteurs détaillant parfois plusieurs approches pour un même problème.

Cette profondeur offre aux modèles d’IA un signal beaucoup plus riche pour l’apprentissage du raisonnement mathématique. Elle rend également la base de données précieuse pour les étudiants. Comme le souligne Shaden Alshammari, qui a elle-même participé aux OIM : « Je me souviens de tant d’étudiants pour qui c’était un effort individuel. Personne dans leur pays ne les entraînait pour ce type de compétition. Nous espérons que cela leur donnera un lieu centralisé avec des problèmes et des solutions de haute qualité pour apprendre. »

L’intelligence artificielle face à ses limites

Au-delà de son rôle éducatif, MathNet sert de banc d’essai rigoureux pour les performances de l’intelligence artificielle. Les résultats brossent un tableau plus nuancé que ce que les récents titres de presse sur les prouesses de l’IA en mathématiques pourraient laisser croire. Certes, les modèles de pointe ont fait des progrès extraordinaires, certains atteignant prétendument des performances de niveau médaille d’or aux OIM. Mais MathNet montre que ces progrès sont inégaux.

Même GPT-5, le modèle le plus performant testé, n’a obtenu qu’un score moyen de 69,3% sur le principal benchmark de MathNet (6 400 problèmes), échouant sur près d’un problème sur trois. Lorsque les énoncés incluent des figures, les performances chutent de manière significative pour tous les modèles, révélant que le raisonnement visuel reste un point faible majeur, même pour les IA les plus avancées.

Un autre enseignement concerne la diversité linguistique. Plusieurs modèles open-source ont obtenu un score de 0% sur les problèmes en langue mongole. « Les modèles GPT sont aussi performants en anglais que dans d’autres langues », précise Alshammari. « Mais de nombreux modèles open-source échouent complètement dans des langues moins courantes comme le mongol. » Cette diversité de MathNet est conçue pour contrer une limite profonde de l’apprentissage de l’IA : en s’entraînant principalement sur des problèmes anglais et chinois, les modèles absorbent une culture mathématique étroite. Un problème de combinatoire roumain ou de théorie des nombres brésilien peut aborder un concept sous un angle totalement différent, enrichissant ainsi la pensée mathématique des humains comme des machines.

De nouveaux défis pour une IA plus intelligente

MathNet introduit également de nouveaux types de tests. L’un d’eux, le « retrieval benchmark », demande aux modèles de reconnaître si deux problèmes partagent la même structure mathématique sous-jacente. Cette capacité est essentielle, car même des comités d’experts humains ont du mal à identifier les équivalences entre des notations et des langues différentes, ce qui a conduit à l’apparition de problèmes quasi-identiques lors de véritables OIM. Les résultats sont sans appel : en testant huit modèles d’intégration de pointe, les chercheurs ont constaté que même le plus performant ne trouvait la bonne correspondance que dans 5% des cas au premier essai.

Un autre test, le « retrieval-augmented generation (RAG) », évalue si le fait de fournir à un modèle un problème structurellement similaire avant de lui en soumettre un nouveau améliore ses performances. La réponse est oui, mais uniquement si l’exemple est pertinent. Le modèle DeepSeek-V3.2-Speciale a gagné jusqu’à 12 points de pourcentage avec un bon exemple, mais ses performances se sont dégradées dans environ 22% des cas avec un exemple non pertinent.

Pour valider la base de données, l’équipe, qui a des liens étroits avec la communauté OIM, a réuni un groupe de plus de 30 évaluateurs humains de pays comme l’Arménie, la Russie, l’Ukraine, le Vietnam et la Pologne. Tanish Patil, chef d’équipe adjoint des OIM de Suisse, confirme son potentiel : « La base de données MathNet a le potentiel d’être une excellente ressource […]. Il sera également intéressant de voir comment cet ensemble de données est utilisé pour améliorer les performances des modèles de raisonnement, et si nous serons bientôt en mesure de répondre […] : déterminer si un problème est vraiment original. »

Une collaboration internationale au service de la connaissance

Ce projet monumental est le résultat d’une collaboration entre de nombreux experts. L’article a été rédigé par Shaden Alshammari avec Navid Safaei, Abrar Zainal (ingénieur IA chez HUMAIN), Sultan Albarakati (directeur de l’académie KAUST et membre du conseil d’administration des OIM), et plusieurs collègues du CSAIL du MIT : Kevin Wen (étudiant en master), Mark Hamilton (responsable principal de l’ingénierie chez Microsoft) ainsi que les professeurs William Freeman et Antonio Torralba.

Leur travail collectif ne se contente pas de préserver un patrimoine intellectuel mondial ; il ouvre de nouvelles frontières pour l’entraînement des intelligences artificielles et offre un outil d’apprentissage inestimable à la prochaine génération de mathématiciens. En rendant ce savoir accessible, MathNet démocratise l’excellence mathématique et pose les bases d’une IA plus polyglotte, plus cultivée et, finalement, plus performante.

Selon la source : phys.org