L’intelligence artificielle pense-t-elle comme nous ? Une étude inédite révèle des failles cachées

Auteur: Mathieu Gagnon

Le mirage d’une ressemblance parfaite

Pendant la dernière décennie, les réseaux de neurones artificiels (ANN) se sont imposés comme la norme en matière de technologie visuelle. Conçus à l’origine pour résoudre des tâches de vision par ordinateur, ces modèles d’intelligence artificielle ont surpris la communauté scientifique. Ils sont en effet devenus la meilleure représentation actuelle pour comprendre le fonctionnement du système visuel de notre propre cerveau.

Une nouvelle étude menée par des chercheurs de l’Université York vient bousculer cette certitude. Leurs travaux, publiés dans la revue Nature Machine Intelligence, révèlent une faille potentielle majeure dans la manière dont ces modèles sont évalués. La question centrale posée par l’équipe remet en cause le parallèle établi jusqu’ici : l’intelligence artificielle actuelle fonctionne-t-elle véritablement comme le cerveau d’un primate ?

Le professeur adjoint de l’Université York, Kohitij Kar, auteur principal de cette nouvelle étude, précise le point de départ de leur réflexion : « Les systèmes d’intelligence artificielle sont souvent décrits comme ‘semblables au cerveau’ car ils peuvent prédire l’activité dans les parties du cerveau qui nous aident à reconnaître les objets. Jusqu’à présent, les scientifiques ont principalement testé cela dans une direction. Ils ont demandé si les modèles d’IA peuvent prédire l’activité cérébrale. »

L’inversion du test de prédictivité

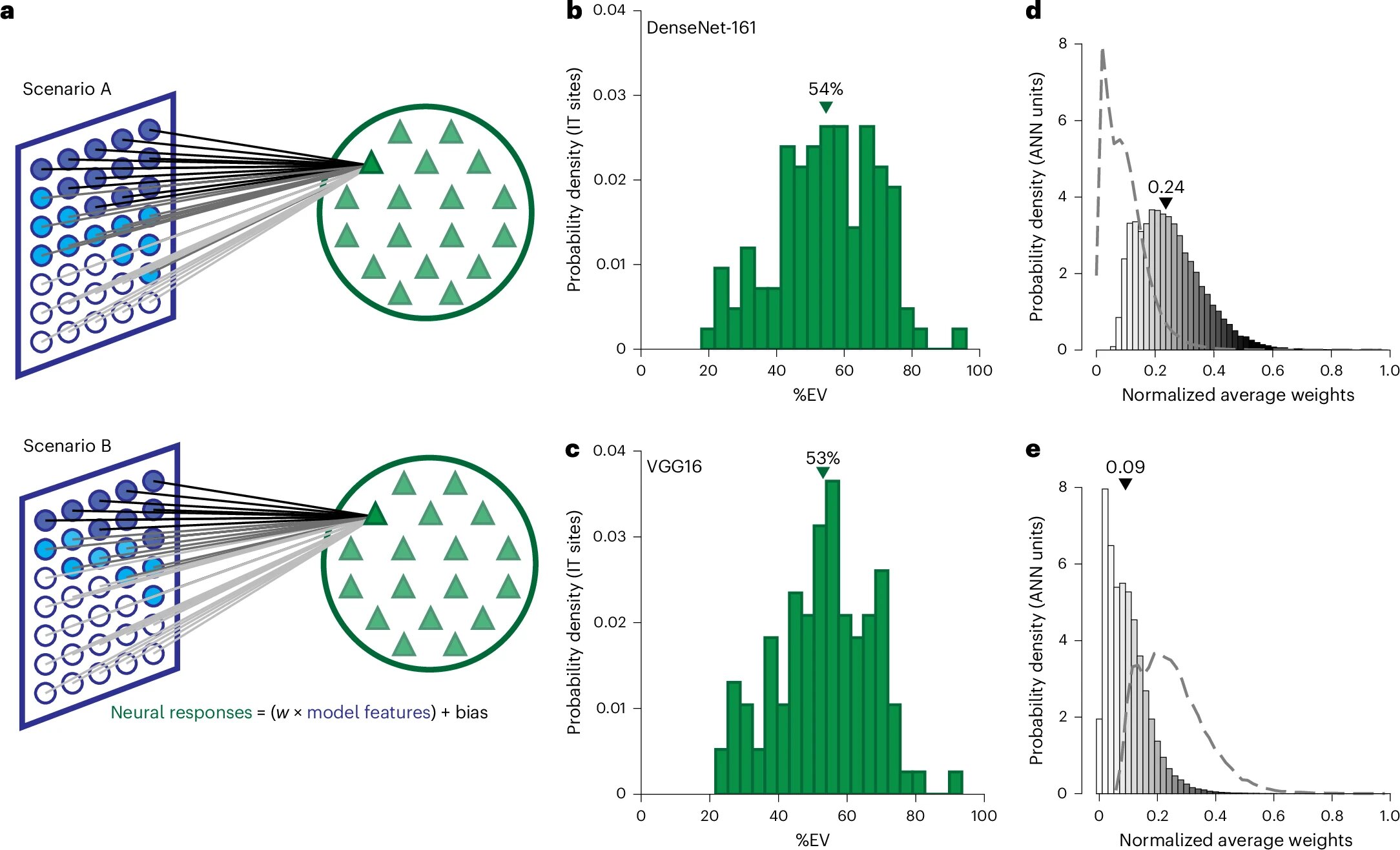

Pour vérifier cette similitude présumée, les chercheurs ont décidé de retourner la méthodologie habituelle. La logique est implacable : si l’intelligence artificielle reflète réellement le cerveau, l’activité cérébrale devrait être capable de prédire ce qui se passe à l’intérieur du modèle d’IA. L’équipe a ainsi mis au point un test de prédictivité inversé pour obtenir une réponse claire.

Kohitij Kar, qui occupe la chaire de recherche du Canada en neurosciences visuelles et agit en tant que membre du Center for Vision Research et du Center for Integrative and Applied Neuroscience de York, souligne la complexité de l’enjeu. L’objectif est d’aller au-delà des apparences pour déchiffrer les mécanismes profonds de la vision, une fonction qui paraît simple mais qui recèle des défis immenses pour les machines.

Il explique l’ampleur du défi technique : « En fin de compte, nous avons besoin de modèles informatiques pour véritablement comprendre les mécanismes neuronaux sous-jacents de la façon dont nous reconnaissons les objets. Comment voyons-nous les objets bouger ? Bien que ce soit une tâche très facile que nous faisons tous les jours, sur le plan informatique, cependant, c’est un problème très difficile ».

Une base de données visuelle massive

La mise en œuvre de ce test de prédictivité inversé a nécessité un dispositif expérimental rigoureux. Les chercheurs, incluant Sabine Muzellec, boursière postdoctorale à York et stagiaire chez Connected Minds, ont soumis le cerveau et l’intelligence artificielle à un vaste ensemble de stimuli visuels afin de comparer leurs réactions respectives.

L’équipe a utilisé un total de 1 320 images, composées de photographies naturelles ou d’images synthétiques naturalistes. Ce corpus précis comprenait des représentations d’un ours, d’un éléphant, d’un visage, d’une pomme, d’une voiture, d’un chien, d’une chaise, d’un avion, d’un oiseau et d’un zèbre. Chaque élément a été placé sur des scènes d’arrière-plan variées, qu’il s’agisse d’environnements naturels, d’intérieurs ou d’extérieurs.

Afin de pousser l’analyse encore plus loin, les scientifiques ont intégré 300 images supplémentaires représentant les mêmes objets, mais rendues de manière différente. Ce groupe de test incluait des contours, des dessins, des formes schématisées ainsi que des variations artistiques, obligeant le système à reconnaître des concepts abstraits.

Le fossé entre la machine et le vivant

L’analyse des données a mis en évidence un décalage majeur entre les deux systèmes. « Les résultats ont été frappants. Alors que les modèles d’IA peuvent assez bien prédire les neurones que nous avons enregistrés dans le cerveau, le cerveau ne peut pas également prédire un grand nombre des caractéristiques internes du modèle. Fait intéressant, ce n’est pas le cas lorsque les neurones d’un cerveau sont comparés à ceux d’un autre cerveau », rapporte le professeur Kar.

Cette asymétrie pose un problème fondamental. Si les réseaux de neurones artificiels résolvent la vision différemment, l’écart entre le cerveau des primates et les modèles informatiques va s’élargir et s’aggraver avec le temps si la trajectoire n’est pas corrigée dès aujourd’hui. L’auteur principal précise que si la prédiction inversée ne fonctionne pas, ces modèles ne constituent pas de bonnes hypothèses pour étudier le cerveau.

Les chercheurs estiment que les machines empruntent des chemins cognitifs distincts. « Les résultats suggèrent que les systèmes d’IA d’aujourd’hui résolvent les tâches visuelles en partie en utilisant des stratégies internes que le cerveau pourrait ne pas utiliser. Fait important, les parties des modèles d’IA qui s’alignent sur le cerveau sont également meilleures pour prédire le comportement humain réel », analyse Kohitij Kar. Sabine Muzellec abonde en ce sens : « Nos résultats remettent en question la similitude réelle des systèmes d’IA actuels avec le cerveau des primates. Nous montrons que des modèles que l’on pensait auparavant similaires au cerveau reposent sur des composants internes que le cerveau ne semble pas utiliser. Nous fournissons une mesure diagnostique bien validée pour le domaine ».

Des enjeux cliniques et médicaux majeurs

L’impact de ces découvertes dépasse le cadre strict de l’informatique. Les modèles d’intelligence artificielle sont de plus en plus utilisés pour concevoir des expériences visant à comprendre le comportement humain, y compris dans des contextes cliniques. Ces approches reposent sur l’hypothèse fondamentale que l’IA perçoit le monde de la même manière qu’un cerveau humain. Actuellement, leur utilisation dans les expériences comportementales est jugée préoccupante, d’autant que des modèles similaires sont déployés pour les systèmes auditifs, linguistiques et moteurs, posant exactement le même problème.

Pourtant, des modèles véritablement alignés sur le cerveau ouvriraient des perspectives inédites. À l’avenir, ils pourraient aider les personnes souffrant du trouble de stress post-traumatique ou d’autisme. Le professeur Kar détaille cet enjeu : « Notre approche aide à identifier quelles parties d’un ANN correspondent véritablement à l’activité cérébrale, ce qui nous permet de construire des modèles plus fiables pour comprendre comment les gens voient et interprètent le monde. Ceci est particulièrement important pour notre programme de recherche sur l’autisme, qui s’appuie sur des modèles de cerveau neurotypique comme point de départ. »

Pour amorcer ce changement de paradigme, les auteurs de l’étude ont rendu publique une boîte à outils de test. Ce dispositif est mis à la disposition des développeurs d’intelligence artificielle afin qu’ils puissent évaluer et améliorer leurs créations à l’avenir. L’étude instaure ainsi une nouvelle norme pour construire une IA qui ne se contente plus d’être puissante, mais qui s’aligne authentiquement sur le fonctionnement du cerveau.

Selon la source : medicalxpress.com