La réévaluation drastique des exigences quantiques

Il est aujourd’hui admis que les ordinateurs quantiques possèdent la capacité de résoudre des problèmes complexes, nécessitant des millions d’années pour leurs homologues classiques. Ces appareils exploitent des propriétés physiques fondamentales, spécifiquement la superposition et l’intrication quantiques, pour traiter l’information.

Une étude récente vient toutefois modifier la chronologie de cette évolution technologique. Publiée sur le serveur de prépublication arXiv, et donc dans l’attente d’une évaluation par les pairs, cette recherche affirme que 10 000 qubits suffiraient pour briser certains des algorithmes de chiffrement actuels les plus utilisés. Les précédentes estimations fixaient cette barrière technique à au moins un million de qubits.

Ce chiffre considérablement réduit s’explique par deux facteurs principaux identifiés par les chercheurs. Les avancées significatives en matière de correction d’erreurs quantiques se combinent à la fiabilité croissante des ordinateurs quantiques à atomes neutres, ces derniers présentant des avantages concrets face aux systèmes à qubits supraconducteurs conventionnels.

Le rôle central de l’algorithme de Shor

L’évaluation des performances de ces machines à grande échelle repose souvent sur une référence mathématique précise : l’algorithme de Shor. Créé en 1994 par le mathématicien Peter Shor, cet outil de calcul permet de factoriser de grands nombres avec une efficacité hors de portée des supercalculateurs classiques.

Cette capacité théorique représente une menace directe pour le chiffrement à clé publique RSA. Ce protocole de sécurité fonde sa robustesse sur la difficulté de cette factorisation mathématique et se retrouve largement utilisé dans le fonctionnement de multiples systèmes critiques actuels.

Cependant, les qubits se révèlent intrinsèquement sujets aux erreurs lors de leur manipulation. C’est cette instabilité qui avait conduit les spécialistes à estimer qu’un million d’unités étaient nécessaires pour exécuter l’algorithme de Shor dans des conditions de fiabilité acceptables, sachant que les systèmes les plus avancés à ce jour ne comptent que quelques centaines de qubits.

L’avènement des atomes neutres et la correction d’erreurs

Le changement de perspective décrit par l’étude repose sur une méthode standard de stabilisation : le regroupement de qubits physiques pour former des qubits logiques. Si l’un des composants physiques subit une panne, les autres prennent en charge les données, permettant aux calculs de se poursuivre sans interruption et rendant le système moins sensible aux perturbations.

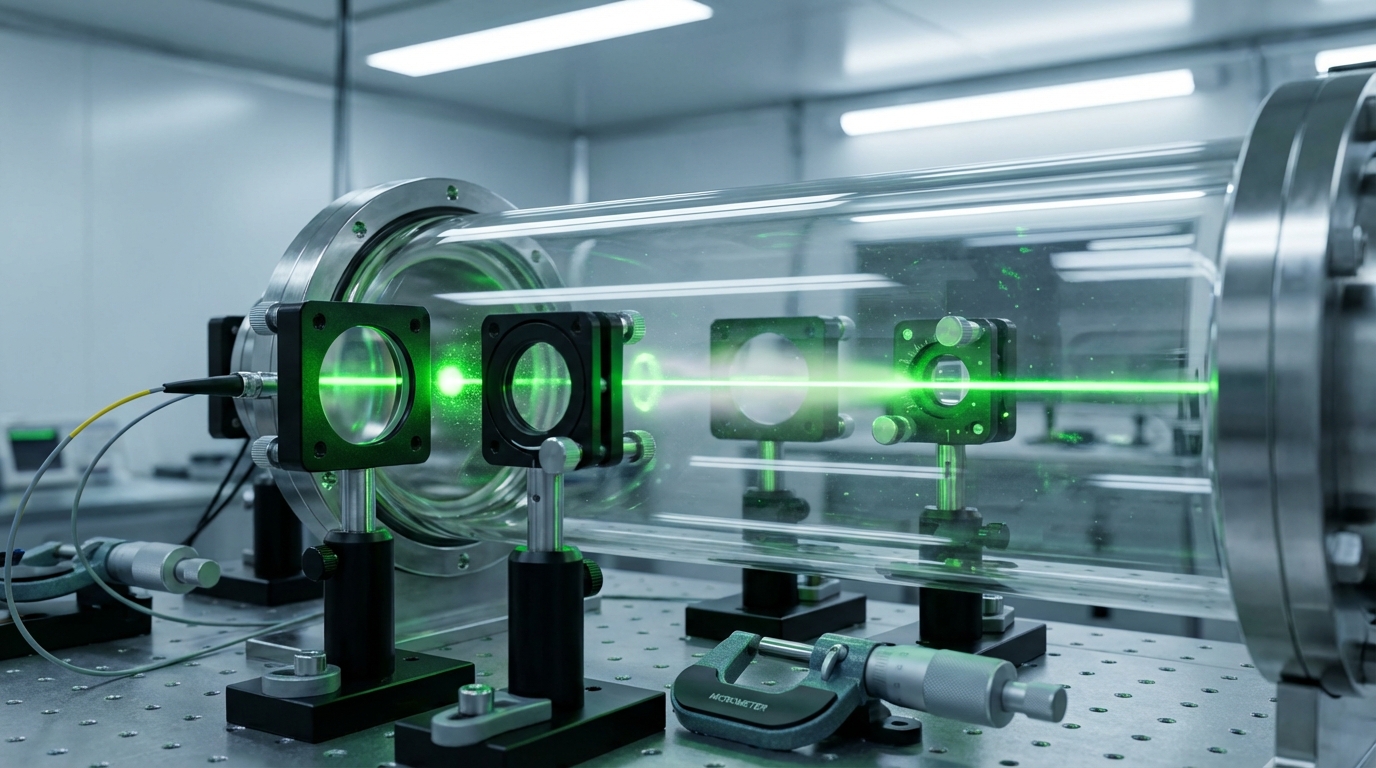

L’utilisation d’ordinateurs quantiques à atomes neutres s’avère déterminante dans ce processus d’optimisation. Leurs qubits sont constitués d’atomes individuels électriquement neutres, à l’image du rubidium, du césium ou de l’ytterbium. Ces éléments sont maintenus en suspension par des faisceaux laser focalisés, nommés « pinces optiques », et refroidis à des températures avoisinant le zéro absolu.

« Bien que des défis d’ingénierie importants subsistent, notre analyse théorique indique qu’une architecture d’atomes neutres correctement conçue pourrait permettre le calcul quantique à des échelles pertinentes en cryptographie », précisent les chercheurs dans leur rapport. Ils ajoutent : « Plus largement, ces résultats soulignent le potentiel des atomes neutres pour le calcul quantique tolérant aux pannes, avec de nombreuses applications scientifiques et technologiques. »

Franchir le seuil de tolérance aux pannes

L’application de ces techniques de stabilisation modifie directement les performances brutes des machines. Une fois la correction d’erreurs appliquée, toute augmentation du nombre de qubits provoque une diminution exponentielle du taux d’erreur, caractérisant un fonctionnement qualifié « en dessous du seuil ». À l’inverse, en l’absence d’une telle méthode, les erreurs tendent à croître avec la taille du système.

Les auteurs de l’étude documentent ces observations de manière détaillée. « Des expériences récentes sur des atomes neutres ont démontré des opérations universelles tolérantes aux pannes en dessous du seuil de correction d’erreurs, des calculs sur des réseaux de centaines de qubits et des réseaux de piégeage avec plus de 6 000 qubits hautement cohérents », notent les scientifiques.

Pour mesurer l’impact de ces avancées, l’équipe a focalisé son attention sur trois modèles cryptographiques spécifiques. Leurs travaux ont examiné l’algorithme de Shor, le schéma à courbe elliptique ECC-256 employé pour sécuriser le trafic Internet et les cryptomonnaies, ainsi que le standard RSA-2048, omniprésent dans la protection des e-mails, des réseaux VPN et du protocole HTTPS.

Vers une accélération de la transition post-quantique

Les simulations livrent des résultats temporels précis concernant la robustesse de ces systèmes. Sans correction d’erreurs, un ordinateur quantique nécessiterait environ un million de qubits pour briser le chiffrement RSA en une semaine, tandis qu’un dispositif de 500 000 qubits compromettrait le standard ECC en quelques dizaines de minutes. Avec des atomes neutres reconfigurables, une architecture d’environ 10 000 qubits suffirait à exécuter l’algorithme de Shor.

L’étude détaille la temporalité de ces opérations avec le système optimisé. Il faudrait entre 10 000 et 26 000 qubits pour décrypter ECC-256 en dix jours, et de 11 000 à 14 000 unités pour casser RSA-2048 en moins de trois ans. Le déploiement d’architectures parallèles totalisant environ 102 000 qubits abaisserait ce dernier délai à seulement 97 jours pour percer le RSA-2048.

La perspective que des machines moins puissantes qu’escompté puissent menacer les normes actuelles appelle à une anticipation de la part du secteur technologique. « Cette conclusion souligne l’importance des efforts continus déployés pour faire évoluer les systèmes cryptographiques largement utilisés vers des normes post-quantiques conçues pour résister aux attaques quantiques », concluent les chercheurs. Des ingénieurs de Google ont récemment appuyé cette nécessité, estimant que cette transition vers la cryptographie post-quantique pourrait devoir s’opérer dans un délai d’environ trois ans.

Selon les sources : trustmyscience.com | arXiv